Если 2024 год стал годом клонов ChatGPT, то 2025 год обещает стать эрой рассуждающих моделей ИИ, а лидерство в этой области захватывают китайские лаборатории. На прошлой неделе много шума наделала DeepSeek со своей рассуждающей моделью R1. А на днях Moonshot AI представила мультимодальную Kimi k1.5, которая обгоняет в тестах OpenAI o1, а стоит в разы меньше. Эти модели представляют собой смену представления о «мыслительном процессе» ИИ.

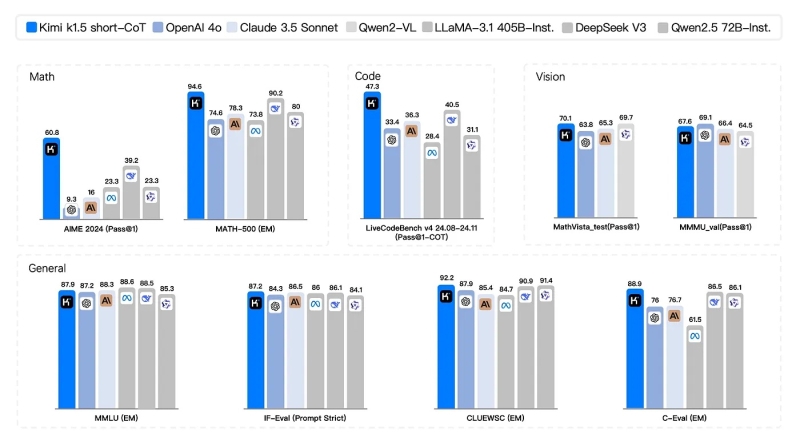

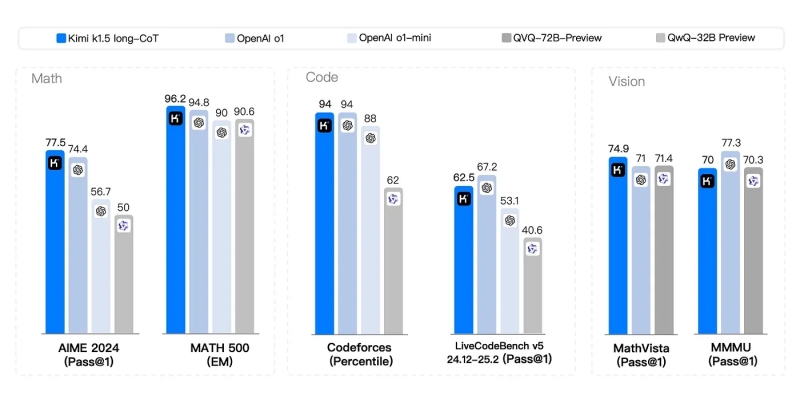

Новые модели далеко ушли от банального пересказа Википедии. Им по силам сложные проблемы — от решения головоломок до объяснения квантовой физики. А Kimi k1.5 уже успела заработать звание «первого настоящего конкурента o1». По оценкам экспертов, Kimi k1.5 — это не просто ещё одна модель ИИ — это скачок вперёд в мультимодальном рассуждении и обучении с подкреплением. Kimi k1.5 от Moonshot AI объединяет текст, код и визуальные данные для решения сложных задач, порою в разы превосходя таких лидеров отрасли, как GPT-4o и Claude Sonnet 3.5 в ключевых тестах.

Контекстное окно Kimi k1.5 на 128 тыс. токенов позволяет модели «за один подход» обрабатывать объём информации, эквивалентный солидному роману. В математических задачах модель может планировать, отражать и корректировать свои шаги на протяжении сотен токенов, имитируя решение проблемы человеком. Вместо того, чтобы повторно генерировать полные ответы, Kimi использует фрагменты предыдущих траекторий, повышая эффективность и сокращая затраты на обучение.

Традиционный подход, основанный на принципах обучения с подкреплением, предполагает использование сложных инструментов, таких как поиск по дереву Монте-Карло или сети ценностей. Команда Moonshot AI отказалась от них и создала упрощённый фреймворк на базе обучения с подкреплением, используя штраф за длину и баланс между исследованием и эксплуатацией. В результате разработчикам удалось создать модель, которая обучается быстрее и избегает «чрезмерного обдумывания» — распространённой ошибки, когда ИИ тратит вычислительные ресурсы на ненужные шаги.

Kimi k1.5 успела показать себя как мощный инструмент визуализации и одновременной работы с текстом. Модель умеет анализировать диаграммы, решать геометрические задачи и отлаживать код — в тесте MathVista модель показала точность 74,9 %, объединив текстовые подсказки с графическими диаграммами.

Исследователи Moonshot AI вместо мощных, но медленных длинноцепочечных рассуждений (Long-CoT) использовали в своей модели метод Long2Short («длинные-в-короткие»), добившись коротких и быстрых ответов. При этом были использованы следующие методы:

- Объединение моделей путём смешивания весов из длинных и коротких моделей CoT.

- Выборка кратчайшего отклонения — выбор из восьми сгенерированных ответов самого короткого и правильного.

- Оптимизация DPO — обучение модели предпочтению кратких ответов бессвязным.

Даже при прямом сравнении Kimi k1.5 оставляет GPT-4o и Claude 3.5 Sonnet далеко позади.

Разработчикам Moonshot AI удалось оптимизировать свой конвейер обучения с подкреплением при помощи:

- Гибридного развёртывания — совместное использование ресурсов ГП для обучения и вывода.

- Частичные развёртывания — разделение длинных траекторий на управляемые фрагменты для эффективного обучения.

- Песочницы кода — безопасные среды для тестирования выходных данных кода, гарантирующие надёжность.

По мнению экспертов, Kimi k1.5 — это не просто техническое чудо — это взгляд в будущее ИИ. Объединяя обучение с подкреплением с мультимодальным рассуждением, эта модель решает поставленные задачи быстрее, умнее и эффективнее.